Systemy rekomendacji stały się nieodłącznym elementem nowoczesnego handlu cyfrowego. To one decydują, co zobaczymy na stronie głównej, które produkty pojawią się w sekcji „dla Ciebie” i jakie oferty trafią do newslettera. Wbrew pozorom, pod hasłem „algorytmy polecania” kryje się bogaty ekosystem metod o odmiennych wymaganiach, zaletach i pułapkach. W tym przewodniku w przystępny sposób wyjaśniamy różnice w algorytmach rekomendacji produktowych – od naiwnych, ale skutecznych list popularności po złożone sieci neuronowe, które uczą się intencji użytkownika w czasie rzeczywistym.

Celem jest nie tylko teoria. Pokażemy praktyczne kryteria wyboru, scenariusze wdrożeniowe, metryki oceny, a także kompromisy między trafnością, skalowalnością i kontrolą biznesową. Jeśli chcesz świadomie dobierać podejścia do polecania, zamiast polegać na buzzwordach, ten artykuł jest dla Ciebie.

Dlaczego rekomendacje mają znaczenie

W e‑commerce rekomendacje wpływają na trzy warstwy wyników:

- Doświadczenie użytkownika – skracają czas dotarcia do produktów, podnoszą satysfakcję i retencję.

- Wyniki komercyjne – zwiększają CTR, CR, AOV oraz przychód na sesję (GMV). Mogą też obniżać koszty akwizycji przez lepsze wykorzystanie ruchu organicznego.

- Efektywność operacyjna – pomagają zarządzać zapasem (promowanie długiego ogona), wspierają merchandising i planowanie kampanii.

Jednak każdy z tych celów wymaga innego kompromisu między jakością a złożonością. Proste algorytmy są szybkie i przewidywalne, lecz często ignorują kontekst użytkownika. Złożone modele uczą się niuansów, ale potrzebują danych, mocy obliczeniowej i starannej walidacji. Zrozumienie, na czym polegają różnice w algorytmach rekomendacji produktowych, pomaga ustawić właściwe oczekiwania i roadmapę rozwoju.

Klasyczny repertuar: od popularności do faktoryzacji

Najpierw fundamenty. Te podejścia stosuje każdy, kto zaczyna przygodę z rekomendacjami. Choć proste, nadal bywają niezastąpione.

Listy popularności i trendy

To najszybszy sposób na sensowne rekomendacje bez personalizacji. Działają szczególnie dobrze w kategoriach o silnej sezonowości lub przy ograniczonych danych o użytkownikach.

- Globalny ranking – „bestsellery”, „najczęściej oglądane”, „najszybciej rosnące”.

- Popularność w kontekście – trend w kategorii, marce lub regionie.

- Zalety – banalne w implementacji, stabilne, odporne na szum.

- Wady – brak personalizacji, ryzyko efektu śnieżnej kuli (promocja tylko topu).

Reguły asocjacyjne (koszykowe)

Klasyka analizy koszyka zakupowego: „klienci, którzy kupili X, często kupili Y”. Reguły typu Apriori czy FP‑Growth opierają się na współwystępowaniu produktów.

- Mocne strony – świetne do cross‑sell i bundlingu („kupowane razem”).

- Ograniczenia – wrażliwe na rzadkość danych; trudne do personalizacji bez dodatkowych warstw.

- Zastosowanie – rekomendacje na stronie koszyka i karty produktu; w e‑mailach potransakcyjnych.

Content‑based filtering (CBF)

Model dopasowuje produkty do profilu użytkownika, zbudowanego z atrybutów treści (kategoria, marka, cena, opis, embedding tekstowy/obrazowy). Działa nawet przy braku historii użytkownika.

- Plusy – dobre na cold‑start itemów; kontrolowalne przez merchandisera.

- Minusy – tendencja do zawężania (polecanie „zbyt podobnych” rzeczy), ograniczona różnorodność.

- W praktyce – wektory cech, miary podobieństwa (cosine, dot‑product), wyszukiwanie ANN w przestrzeni embeddingów.

Filtracja kolaboratywna: user‑based vs item‑based

Współpraca tłumu: użytkownicy o podobnych zachowaniach lub produkty współwystępujące w interakcjach. Dwa archetypy:

- User‑based – znajdź „sąsiadów” użytkownika (na bazie ocen/klików), poleć to, co lubią.

- Item‑based – znajdź „sąsiadów” produktu (na bazie współoglądalności/zakupów), poleć podobne.

Zalety: wykorzystują mądrość tłumu, dobrze skalują się semantycznie bez etykiet domenowych. Wady: efekt zimnego startu, rozrzedzenie macierzy, wrażliwość na popularność. W praktyce item‑based bywa stabilniejszy i tańszy do utrzymania, zwłaszcza przy dużej liczbie użytkowników.

Faktoryzacja macierzy i modele implicite

Faktoryzacja (np. SVD, ALS, BPR) rozkłada macierz interakcji na wektory użytkowników i produktów w przestrzeni latentnej. Pozwala generalizować poza bezpośrednie sąsiedztwo.

- Explicit vs implicit – oceny jawne vs sygnały pośrednie (klik, czas, dodał do koszyka). Modele implicit ważkują obserwacje i pewność.

- BPR – uczenie preferencji parowych (produkt A preferowany nad B) zoptymalizowane pod ranking.

- Atuty – dobra jakość przy umiarkowanej złożoności; prosta inferencja via iloczyn skalarny embeddingów.

- Ograniczenia – liniowość interakcji, brak jawnego modelowania kontekstu i sekwencji.

Nowa fala: algorytmy sekwencyjne, głębokie i hybrydowe

Kiedy biznes rośnie, rosną ambicje. Chcemy rozumieć intencje, przewidywać kolejne kroki w sesji i równoważyć cele. Tu wchodzą modele nowej generacji.

Modele sesyjne i sekwencyjne

Odwzorowują kolejność interakcji: co użytkownik klikał w tej sesji i jak to wpływa na następny wybór. Popularne podejścia:

- RNN/GRU4Rec – uczą się przejść między zdarzeniami, dobrze działają na krótkich sekwencjach zakupowych.

- Transformers – samo‑uwaga (self‑attention) wychwytuje zależności długiego zasięgu; modele takie jak SASRec, BERT4Rec.

- Markov i modele n‑gram – prostsze łańcuchy przejść, szybkie i interpretowalne.

Korzyść: trafniejsze wyniki „tu i teraz” (np. re‑ranking listy na karcie kategorii). Wyzwanie: potrzeba świeżych danych zdarzeniowych oraz infrastruktury czasu rzeczywistego.

Głęboka personalizacja: NCF, two‑tower, DLRM

Sieci neuronowe uczą się nieliniowych interakcji między użytkownikiem, produktem i kontekstem.

- Neural Collaborative Filtering (NCF) – MLP na wektorach embeddingów użytkownik‑produkt zamiast czystego iloczynu skalarnego.

- Two‑tower (dual encoder) – osobne wieże dla użytkownika i produktu; świetne do szerokiego „retrieval” dzięki ANN.

- DLRM / Wide & Deep – łączą cechy kategoryczne (hashing, embeddings) z sieciami głębokimi i komponentem „wide” dla pamięci reguł.

- Autoenkodery, VAE – kompresja sygnałów do bogatych embeddingów; często używane do cold‑startu i odszumiania.

Zalety: wysoka jakość rankingów, możliwość dodawania cech kontekstowych (lokalizacja, pora dnia, źródło ruchu). Wady: wymagają dużych zbiorów, starannej walidacji i zasobów GPU oraz przemyślanej regularizacji, by uniknąć przeuczenia.

Algorytmy grafowe i knowledge graphs

Produkty i użytkownicy tworzą graf powiązań: współoglądalności, wspólne tagi, atrybuty domenowe. GNN (Graph Neural Networks), random walki (Node2Vec) i metody oparte na ścieżkach w grafie wiedzy pozwalają lepiej rozumieć strukturę oferty.

- Plusy – naturalne łączenie wielu typów relacji; odkrywanie nietrywialnych powiązań.

- Minusy – złożona inżynieria danych; skalowanie uczenia na dużych grafach.

- Zastosowania – uzupełnianie luk w katalogu, lepsza semantyka kategorii, serendipity.

Hybrydy, bandyci kontekstowi i RL

Niezależnie od modelu predykcyjnego, trzeba rozwiązać dylemat eksploracji kontra eksploatacji i uwzględnić cele biznesowe.

- Hybrydy – łączenie CB, CF i modeli głębokich; różne algorytmy dla candidate generation, rankingu i re‑rankingu.

- Bandyci kontekstowi – dynamiczne testowanie wariantów (UCB, Thompson Sampling) z uwzględnieniem cech sesji.

- Reinforcement Learning – optymalizacja sekwencji rekomendacji pod długoterminowy reward (LTV, retencja), z polityką zależną od stanu użytkownika.

Te warstwy nie zastępują predykcji – raczej ją „otulają”, poprawiając decyzje w kontekście niepewności, ograniczeń i wielokryterialnych KPI.

Rzeczywiste różnice między algorytmami: co, kiedy i dlaczego

W praktyce najważniejsze są różnice w danych wejściowych, złożoności, jakości wyników i możliwości kontroli. Poniżej porównujemy je przez pryzmat codziennych decyzji produktowych. Dzięki temu zobaczysz, jak rozumieć różnice w algorytmach rekomendacji produktowych bez uciekania się do ogólników.

Dane wejściowe i sygnały

- Brak historii użytkownika – stawiaj na CBF, popularność w kontekście, reguły merchandisera.

- Skąpa historia i dużo atrybutów – CBF + faktoryzacja/NCF z cechami; modele two‑tower do retrieval.

- Bogate logi zdarzeń – sekwencyjne (GRU4Rec, SASRec) i rankery głębokie (DLRM).

- Sygnały implicite – BPR/ALS implicit; staranne ważenie (czas, dwell time, dodanie do koszyka).

Skalowalność i koszty

- Proste listy – minimalny koszt, świetne jako fallback.

- Item‑based CF – dobre skalowanie; łatwy cache sąsiedztw produktów.

- Faktoryzacja – trenowanie okresowe; inferencja szybka (dot product).

- Modele głębokie – drogie w treningu i infrastrukturze (feature store, orkiestracja, ANN z wektorami).

Jakość, uogólnienie i stabilność

- Popularność – stabilna, ale mało zróżnicowana.

- CBF – precyzja w obrębie bliskich podobieństw; ryzyko bańki filtrującej.

- CF/faktoryzacja – lepsza „serendipity” niż CBF; wrażliwe na zimny start.

- Głębokie/sekwencyjne – najwyższa trafność w dynamicznych kontekstach; uwaga na „drift” danych i konieczność retreningu.

Cold‑start: użytkownicy i produkty

- Nowy produkt – CBF z embeddingami opisów/obrazów, graf wiedzy, boost kampanijny.

- Nowy użytkownik – popularność w kontekście, krótkie quizy preferencji, personalizacja na podstawie źródła ruchu.

- Nowa kategoria – semantyka kategorii (graf), transfer learning z podobnych działów.

Kontrolowalność, interpretowalność, zgodność z politykami

- Reguły/CBF – łatwe do wyjaśnienia („polecamy, bo podobne do X”).

- CF/faktoryzacja – częściowa wyjaśnialność przez podobieństwa i czynniki latentne.

- Deep/RL – trudniejsze do interpretacji; potrzebne narzędzia XAI, monitorowanie driftu i biasu.

Architektura systemu rekomendacyjnego

Niezależnie od wybranego algorytmu, skuteczny system ma zwykle trójwarstwową architekturę. Zrozumienie jej pomaga praktycznie wykorzystać różnice w algorytmach rekomendacji produktowych i łączyć je w spójny silnik.

1. Candidate generation (retrieval)

Odsiew setek tysięcy produktów do setek kandydatów. Często dwa wieżowce (two‑tower) lub item‑based CF; wykorzystywane wyszukiwanie przybliżonych sąsiadów (ANN) w wektorowej przestrzeni embeddingów.

- Wymagania – wektory użytkownika i produktu, FAISS/ScaNN/Elasticsearch vector.

- Cel – szybki recall bez przesadnej precyzji.

2. Ranking

Precyzyjne uporządkowanie kilkuset kandydatów. Tu najczęściej lądują DLRM, GBDT (np. XGBoost), Wide & Deep, a w podejściach klasycznych – BPR lub logistyczny ranking.

- Cechy – bogate featury: cechy użytkownika, produktu, pary user‑item, kontekst (czas, urządzenie, źródło).

- Straty – pairwise (BPR), listwise (LambdaRank), focal/weighted cross‑entropy na sygnałach implicite.

3. Re‑ranking i post‑processing

Ostatnia mila, która uwzględnia zasady biznesowe i wielokryterialne cele:

- Dywersyfikacja – MMR, xQuAD, penalizacja nadmiernej podobności.

- Serendipity – kontrolowane wtrącanie nowości i długiego ogona.

- Ograniczenia – stany magazynowe, marża, SLA kampanii, brand safety.

Feature store i świeżość danych

Bez spójnego repozytorium cech (feature store) nawet najlepszy model zawiedzie. Kluczowe są:

- Spójność on‑/offline – te same transformacje w treningu i serwowaniu.

- Świeżość – aktualizacja cech w minutach/sekundach dla scenariuszy sesyjnych.

- Jakość – walidacje schematów, monitoring braków i odchyleń.

Dobór algorytmu do scenariusza

Nie ma jednego najlepszego podejścia. Wybór zależy od etapu rozwoju, danych i celów.

Nowy sklep z ograniczonym ruchem

- Bazowo – listy popularności per kategoria, reguły asocjacyjne, CBF z atrybutów katalogu.

- Stopniowo – item‑based CF na współoglądalności; proste faktoryzacje implicite.

- Dlaczego – szybka wartość bez dużej infrastruktury; łatwa kontrola merchandisera.

Skala marketplace’u

- Retrieval – two‑tower na ogromnych logach + ANN.

- Ranking – DLRM/Wide & Deep z bogatymi cechami; per‑domena modele.

- Re‑ranking – dywersyfikacja, budżety kampanii, popyt/podaż.

Asortyment specjalistyczny (B2B, nisze)

- CBF – precyzyjne dopasowanie po parametrach technicznych, embeddingi opisów.

- Graf wiedzy – modelowanie kompatybilności (zgodność części, standardy).

- Uzupełnienie – reguły eksperckie i walidacja domenowa.

Silna dynamika cen i dostępności

- Sekwencyjne – adaptacja do trendów; re‑ranking z uwzględnieniem stanów i cen.

- Bandyci – szybka eksploracja wariantów listy w warunkach niepewności.

Ewaluacja: od offline do online

Różne algorytmy świecą w różnych metrykach. Dobrze zdefiniowane KPI to połowa sukcesu.

Metryki offline

- Recall@k, Precision@k – czy w top‑k są właściwe produkty.

- NDCG/MAP – jakość pozycji w rankingu.

- AUC/ROC/PR – dla binarnych predykcji interakcji.

- Coverage, diversity – pokrycie katalogu i różnorodność list.

Uwaga na data leakage i niereprezentatywne splitowanie czasu (potrzebny split temporalny). Modele sekwencyjne oceniamy scenariuszowo (next‑item prediction).

Eksperymenty online

- A/B testy – CTR, CVR, add‑to‑cart rate, revenue per session.

- Testy wielowariantowe – w połączeniu z bandytami dla efektywnej eksploracji.

- Metryki długoterminowe – retencja, LTV, satysfakcja; unikaj "myopic optimization".

Pułapki i dobre praktyki

Najlepszy algorytm nie uratuje złych danych ani złej definicji celu. Oto checklista ryzyk i nawyków.

- Popularność vs personalizacja – nadmiar topów pogarsza doświadczenie; dodaj dywersyfikację i serendipity.

- Cold‑start – planuj z wyprzedzeniem: CBF, kampanie seedujące, aktywacja użytkownika.

- Drift danych – monitoruj zmianę rozkładów cech i wyników; automatyzuj retraining.

- Spójność featurów – gwarantuj identyczne transformacje on/offline, waliduj schematy.

- Bias i fairness – niepromowanie wyłącznie marek dominujących; kontroluj expoure i coverage.

- Explainability – podawaj powody rekomendacji („podobne do…”, „inspiracje na podstawie…”).

- Bezpieczeństwo i prywatność – minimalizacja danych, anonimizacja, edge/federated learning, przetwarzanie zgodne z regulacjami.

Przykładowe zastosowania w lejku zakupowym

Różne miejsca i intencje – różne algorytmy i priorytety.

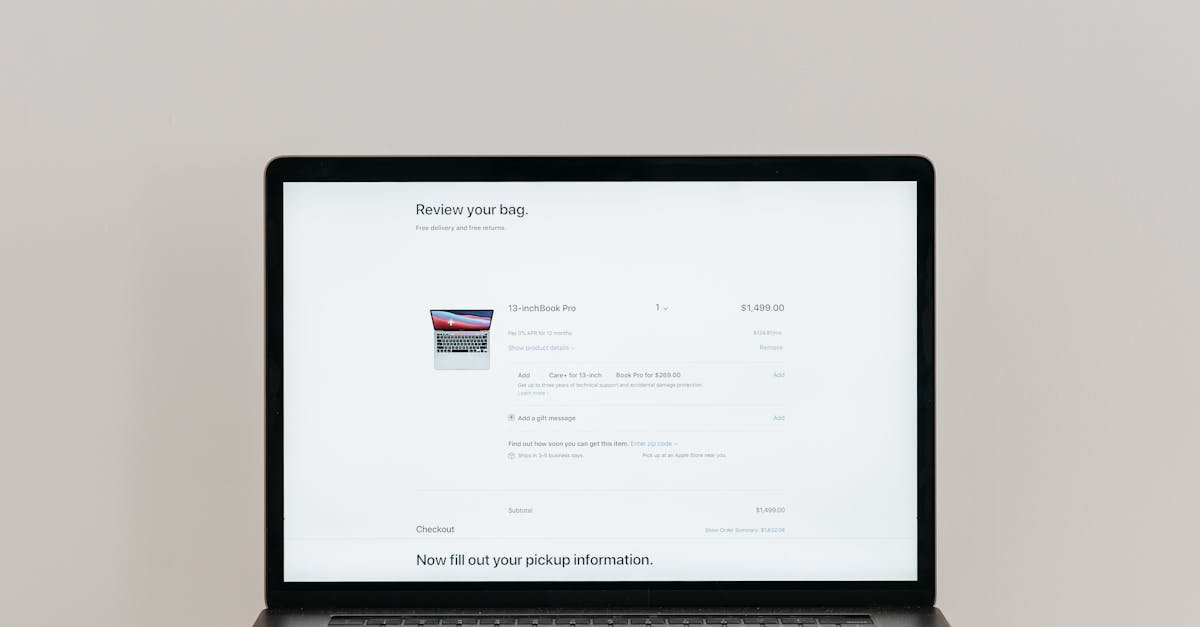

- Strona główna – mieszanka popularności, personalizacji i kampanii; retrieval two‑tower + re‑ranking.

- Karta produktu – item‑based podobne, CBF po atrybutach, reguły „kup razem”.

- Kategoria/lista – re‑ranking sesyjny; modele sekwencyjne i boosty merchandisingowe.

- Wyszukiwarka – personalizacja wyników, query understanding (NLP), wektorowe dopasowanie semantyczne.

- E‑mail/push – segmentacja + bandyci; priorytetyzacja według prawdopodobieństwa zakupu i marży.

Trendy: dokąd zmierzają rekomendacje

Świat rekomendacji szybko się zmienia. Co widać na horyzoncie?

- Causal recommendation – modele przyczynowe i de‑biasing logów (propensity scoring) dla lepszego uogólnienia online.

- RL na dużą skalę – łączenie krótkoterminowych KPI z długoterminową satysfakcją.

- On‑device/edge – prywatność i niskie opóźnienia; personalizacja w przeglądarce/aplikacji.

- Foundation models – multimodalne embeddingi (tekst+obraz+recenzje) i generatywne wyjaśnienia rekomendacji.

- Vector DB i ANN – powszechne silniki wektorowe, łączące wyszukiwanie i rekomendacje.

Studium porównawcze: kiedy który algorytm wygrywa

Podsumujmy praktycznie kluczowe różnice – to szybka mapa decyzji.

- Masz mało danych – zacznij od CBF i popularności; dodaj item‑based CF, gdy zbierzesz współoglądalność.

- Duży katalog, duży ruch – two‑tower do retrieval, DLRM do rankingu, re‑ranking z dywersyfikacją i ograniczeniami.

- Szybko zmieniające się trendy – modele sekwencyjne i bandyci do eksploracji.

- Silne wymagania wyjaśnialności – CBF, reguły, prostsze CF/faktoryzacje z kontrolowalnymi boostami.

- Wysoka wrażliwość biznesowa – architektura trójwarstwowa z post‑processingiem; monitorowanie wpływu na marżę i zapas.

Checklist wdrożeniowy

Przed przejściem „od tłumu do neuronów” upewnij się, że spełniasz warunki dojrzałości.

- Dane – spójny katalog, identyfikatory, logi zdarzeń z timestampami, etykiety jakości.

- Infrastruktura – pipeline ETL/ELT, feature store, system eksperymentów, serwowanie niskolatencyjne.

- Modele – baseline’y (popularność, CBF), kandydujący (CF/faktoryzacja), ambitny (two‑tower/DLRM), warstwa bandytów.

- Kontrola – mechanizmy wykluczeń, reguły kampanii, limity ekspozycji.

- Monitoring – metryki jakości (CTR, CVR), techniczne (latencja, SLA), drift i alerty.

Najczęstsze pytania

Czy modele głębokie zawsze wygrywają?

Nie. Głębokie podejścia wymagają skali, dojrzałej inżynierii danych i budżetu. W wielu sklepach dobrze zestrojona faktoryzacja z solidnym re‑rankingiem dorównuje lub przewyższa złożone sieci przy znacznie niższych kosztach.

Jak unikać efektu popularności?

Ustaw penalizację ekspozycji najczęściej pokazywanych produktów, wprowadź dywersyfikację oraz ucz ranker na zbalansowanych próbkach (propensity weighting). W re‑rankingu dodaj reguły biznesowe promujące długi ogon.

Co z prywatnością i zgodnością?

Minimalizuj i anonimizuj dane użytkowników, preferuj agregaty i embeddingi. Rozważ federated learning lub on‑device personalizację w krytycznych kontekstach. Zapewnij zgodność z regulacjami i transparentność uzasadnień rekomendacji.

Podsumowanie

„Od tłumu do neuronów” to nie wyścig po najnowszy buzzword, lecz konsekwentne budowanie wartości: od stabilnych baseline’ów, przez modele kolaboratywne i faktoryzacje, aż po sekwencyjne i głębokie rankery. Kluczem jest zrozumienie, jakie są praktyczne różnice w algorytmach rekomendacji produktowych: wymagania danych, koszty, skalowalność, interpretowalność i wpływ na cele biznesowe. Najlepsze systemy łączą wiele metod w jedną architekturę – candidate generation, ranking i re‑ranking – a następnie stale uczą się na danych, eksperymentując w kontrolowany sposób.

Jeśli dopasujesz algorytm do etapu rozwoju, jakości danych i priorytetów KPI, zbudujesz silnik polecania, który nie tylko podnosi CTR, ale też buduje długoterminową satysfakcję klientów i przewagę konkurencyjną.